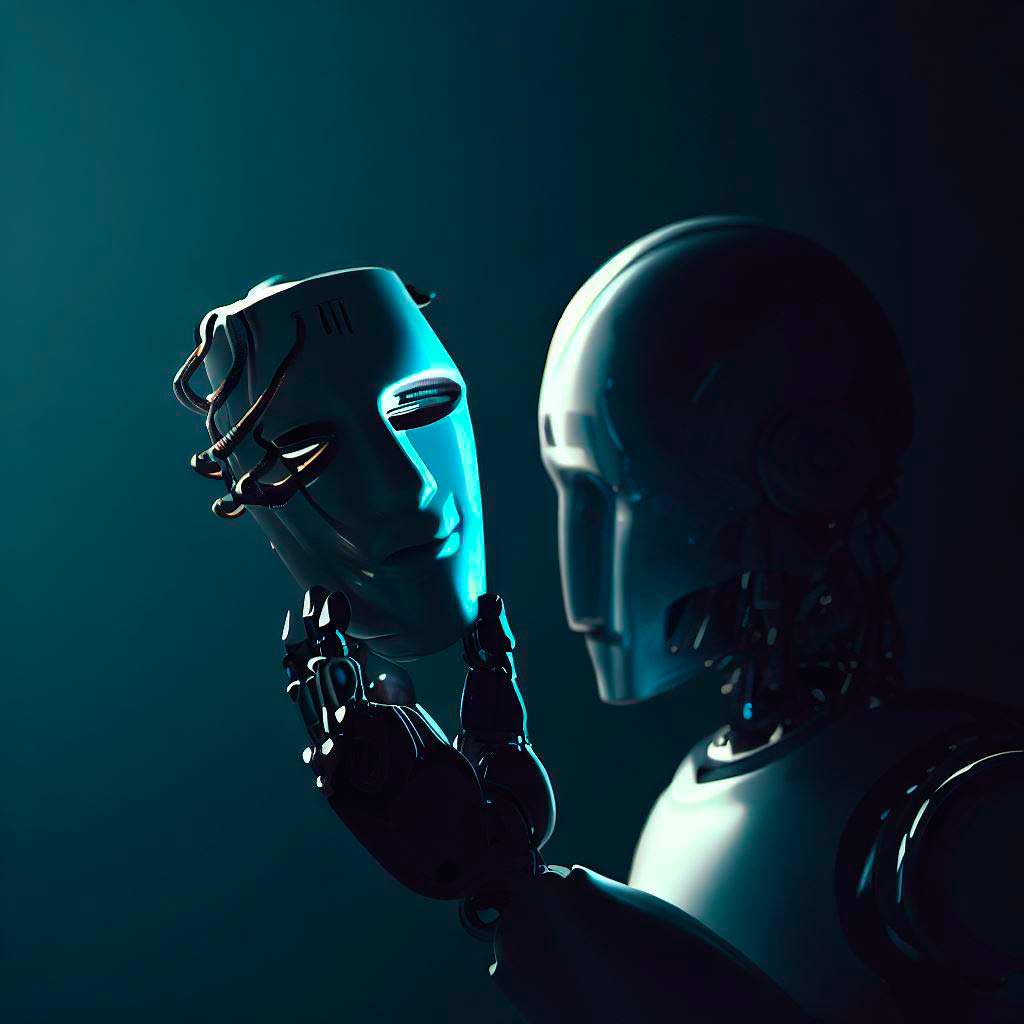

A principal característica da Inteligência Artificial Generativa é gerar textos, fotos e vídeos. Estas produções das ferramentas de IA são conhecidas como “mídia sintética”. Popularizada por aplicativos como o “Reface”, as primeiras experiências de Deepfake (troca de rostos e voz em vídeos) assustaram por demonstrar o potencial de sua utilização em ações de desinformação. Contudo o simples compartilhamento de textos não confiáveis gerados por LLM como o ChatGPT já pode promover tal situação.

Como o ChatGPT tem uma capacidade de processamento muito grande, pode produzir textos convincentes sobre diversos temas. O usuário, sem conseguir discernir a veracidade das informações, acaba compartilhando este material e os receptores o entendem como informação confiável.

O cenário acima já está em prática por diversos influenciadores da internet que utilizam o ChatGPT para produzir “dicas” para sua audiência sobre temas que não dominam. Tal situação é mais preocupante quando se trata da área da Saúde.

O canal no YouTube do influenciador Murilo Bevervanso possui quase 250 mil seguidores. No vídeo “Chatgpt cria videos do Youtube pra voce em alguns cliques Aprenda a como ganhar dinheiro No Youtube” (https://youtu.be/zYsLmKtIyG8), Murilo ensina a produção de dicas de emagrecimento com informações de nutrição, exercícios físicos e pressão arterial com base em consulta ao ChatGPT. Não há nas respostas do ChatGPT nenhuma indicação de fonte e nem confirmação de que as informações foram atestadas por profissionais de Nutrição e Educação Física.

No vídeo acima, o influenciador ainda mostra a como utilizar o texto gerado pelo ChatGPT para alimentar outra ferramenta de IA, a Synthesia, por onde é possível criar um avatar virtual e uma locução sintética para um vídeo que será postado no YouTube com o objetivo de influenciar pessoas.

Já no canal “Ganhando no Automático”, o influenciador Marcos Teixeira sugere o uso do ChatGPT em conjunto com a ferramenta de “Invideo”. No vídeo “Como criar vídeo em segundos com inteligência artificial grátis e zero de experiência” (https://youtu.be/8wrnG4q0jgM), Marcos mostra que o aplicativo “Invideo” processa o texto gerado pelo ChatGPT e monta automaticamente um vídeo-legenda com imagens relacionadas aos temas abordados.

Na mesma linha, o canal “Gus.A.I” perguntou ao ChatGPT quais os melhores assuntos para um canal do youtube e recebeu a indicação de “saúde” entre uma das possibilidades. Também no vídeo “Como criar Videos Youtube com ChatGPT-OpenAI / 100% Automático com Edição de Inteligência Artificial” (https://youtu.be/Vqvc_xBoqkE), o youtuber ensina a usar a ferramenta “Pictory”, um aplicativo de edição de vídeo baseado em IA que monta automaticamente um vídeo-legenda a partir de textos do ChatGPT.

Os três casos acima acendem o sinal amarelo para a criação de mídia sintética em massa a partir da integração de serviços de IA Generativa, principalmente na área da Saúde.

Há iniciativas no sentido de aprimorar a base de dados com a qual a IA Generativa é treinada. O GPT-3, por exemplo, é treinado lançando mão das bases Common Crawl, WebText2, Wikipedia, Books1 e Books2. A proposta alternativa seria limitar este universo apenas a textos acadêmicos, como testado pela ferramenta “Consensus”. Entretanto, parte dos artigos científicos encontra-se em repositórios fechados (situação contrária à Open Science), além disso existe o entendimento de que as publicações científicas apresentam visões sobre temas e não constituem uma verdade universal, sendo assim, mesmo em artigos revisados pelos pares, as conclusões precisam ser interpretadas pelo leitor como uma tese.

No mesmo sentido do Consensus, o investidor estadunidense Elon Musk anunciou o desenvolvimento da ferramenta TruthGPT, que teria como diferencial uma pretensa busca da verdade. Musk foi um dos signatários da carta do instituto Future of Life que pede uma pausa nos experimentos com Inteligência Artificial.

No campo da Saúde, esta preocupação é maior pois a desinformação pode resultar em mortes direta ou indiretamente, como constatado durante a Infodemia no contexto da Covid-19. Como vimos, há no Brasil uma desigualdade no acesso à internet reforçada pelos planos “zero-rating”, contribuindo para que a predominância das informações seja acessada via mídias sociais pelas classes C, D e E. Somada a isto, a descrença com meios de comunicação tradicionais e a popularização dos influencers (influenciadores digitais) cria um ambiente propício para a dinâmica da “apomediação” (SOUZA, 2020) (apomediation), apontada pela pesquisadora Nicole Fajardo Maranha Leão de Souza, ao analisar o comportamento de um grupo de estudantes que optava preferencialmente por informar-se pelas recomendações de outros usuários da internet.

Em paralelo à penetração da IA Generativa, é preciso apostar em políticas públicas que promovam a educomunicação, trabalhando o desenvolvimento de habilidades de leitura crítica da mídia. A Finlândia, por exemplo, é considerada como um país sem fake news, pois incluiu no currículo escolar a alfabetização midiática (BENKE; SPRING, 2022).

Mesmo tendo sua popularização apenas recentemente, a IA Generativa já causou alguns casos de desinformação em escala global. Imagens sintéticas do Papa Francisco vestindo um casaco fashion e do ex-presidente Donald Trump sendo detido viralizaram na internet. Muitas pessoas acreditaram nas imagens que já contavam com grande realismo após a atualização da ferramenta Midjourney. A polêmica trouxe novos usuários para o aplicativo que decidiu manter seu funcionamento apenas para assinantes a um preço mínimo de oito dólares mensais.

Mais um ponto de atenção reside na possibilidade de o ChatGPT exibir anúncios em suas respostas. Ainda não está claro como esta funcionalidade será implementada, mas a mesma deve ocorrer com muita precaução para que as respostas orgânicas não sejam confundidas com as publicidades, assim como ocorre na busca do Google, onde há grande destaque aos anúncios e a diferenciação visual é pouco perceptível.

A situação pode ser ainda mais grave se nas respostas houver privilégio à consulta de textos de determinado anunciante, dentro de uma estratégia de Marketing de Conteúdo. A título de comparação, o conflito de interesses seria análogo caso outras ferramentas de IA como Waze e Google Maps alterassem seus resultados para que a rota passasse por algum comércio anunciante. Com a Internet das Coisas (IoT), tal situação ficaria ainda mais crítica, pois o sistema de IA teria acesso a dados como o combustível restante e a agenda (consultando festas e indicando possibilidade de compra de presentes), fazendo com que o motorista pare em determinado shopping ou posto de gasolina a partir da influência do aplicativo.

REFERÊNCIAS:

Arthur William Santos é mestre em Educação, Cultura e Comunicação (UERJ), pós-graduado no MBA de TV Digital, Radiodifusão e Novas Mídias de Comunicação Eletrônica (UFF), graduado em Comunicação Social / Jornalismo (PUC-Rio) e técnico em eletrônica (CEFET-RJ). Foi gerente executivo de Produção, Aquisição e Parcerias na EBC, além de gerenciar o setor de Criação de Conteúdos e coordenar as Redes Sociais da TV Brasil. Liderou também a área de Inovação/Novos Negócios na TV Escola. Atuou ainda na criação do Canal Educação e do Canal LIBRAS para o Ministério da Educação (MEC). Fez cursos presenciais em Harvard e Stanford sobre Inovação na Educação. Deu aulas em cursos de graduação e pós-graduação nas universidades UniCarioca, Unigranrio, FACHA, INFNET e CEFOJOR (Angola). É membro da SET (Sociedade de Engenharia de Televisão).